新聞稿

私隐专员公署提醒“领英”(LinkedIn)用户 留意个人资料被用于生成式人工智能模型训练

日期: 2024年10月3日

私隐专员公署提醒「领英」(LinkedIn)用户

私隐专员公署提醒「领英」(LinkedIn)用户

留意个人资料被用于生成式人工智能模型训练

个人资料私隐专员公署(私隐专员公署)留意到,职场社交媒体平台「领英」(LinkedIn)最近更新了私隐政策,使领英可以使用其用户在平台上的个人资料和内容来训练生成式人工智能模型创作内容,并将同意有关用途的用户选择预设为「开启」(即「同意」)。

领英的私隐政策更新在其他司法管辖区引起了资料保障机构的关注,而私隐专员公署对于预设使用用户的个人资料来训练生成式人工智能模型的预设设定,是否正确反映用户的意愿,同样表示关注。因此,公署已去信领英了解有关情况。

个人资料私隐专员钟丽玲提醒领英用户应留意领英私隐政策的更新,了解相关政策内容,以决定是否同意领英使用他们的个人资料来训练人工智能模型。如果领英用户不愿意授权领英使用他们的个人资料进行生成式人工智能模型的训练,可以按照以下步骤(https://www.linkedin.com/mypreferences/d/categories/privacy)更改有关预设设定以撤销权限:

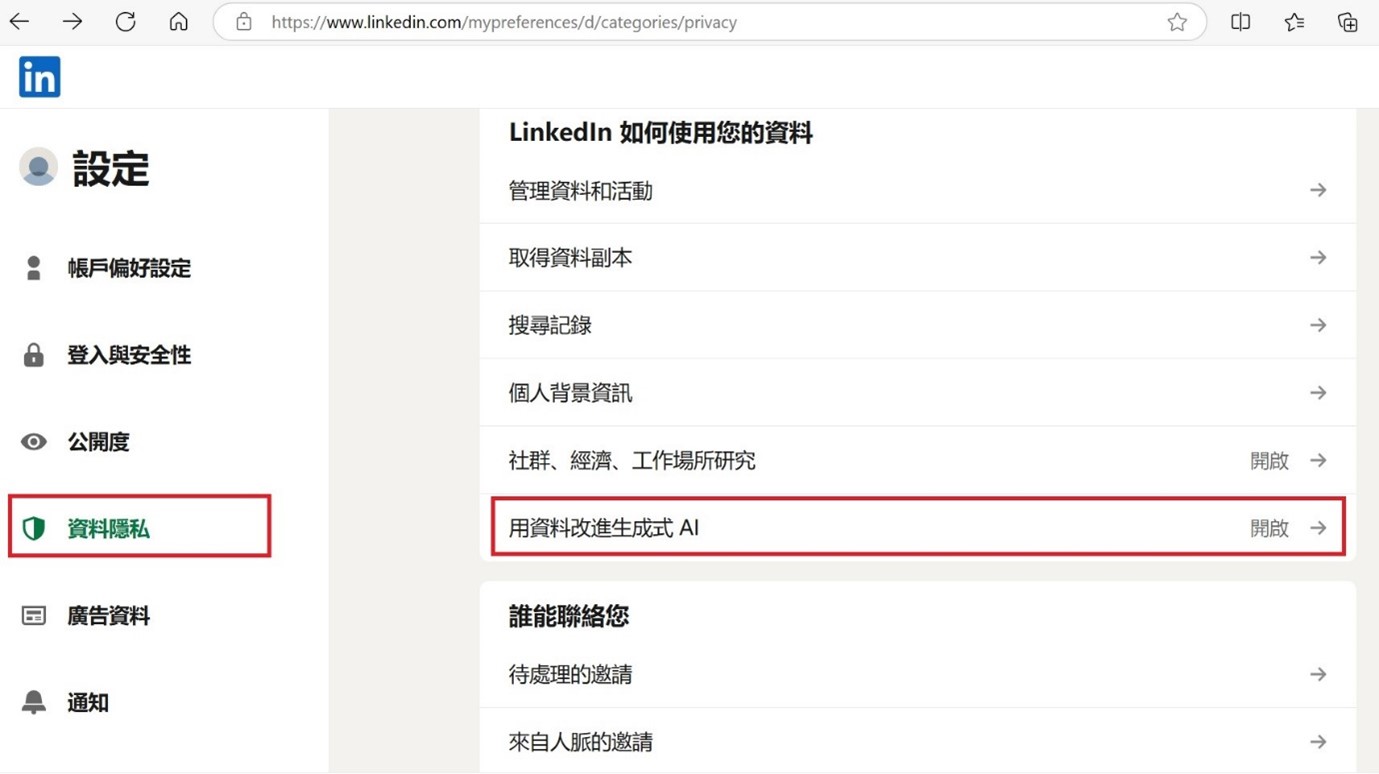

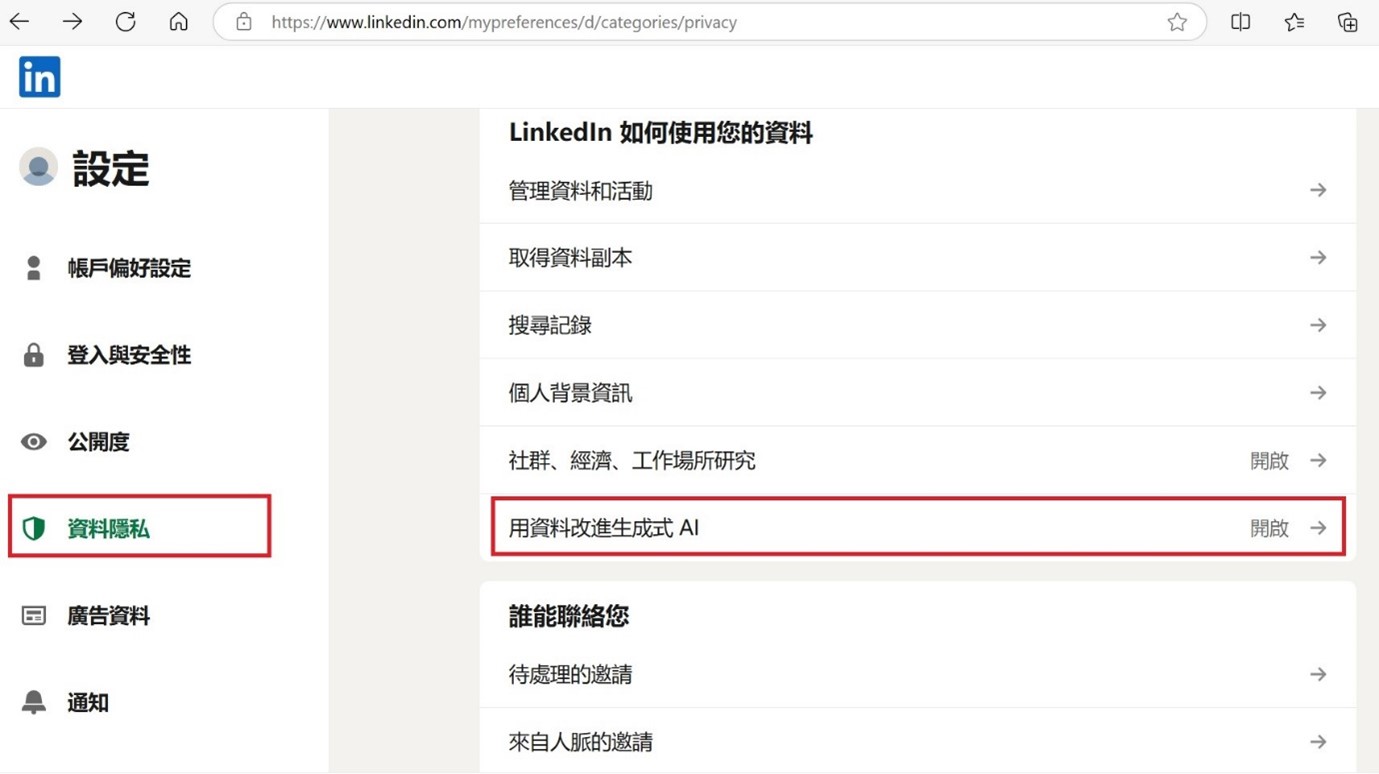

1. 前往帐户设定中的「资料隐私」部分,然后选择「用资料改进生成式AI」以找到相关选项。

领英的私隐政策更新在其他司法管辖区引起了资料保障机构的关注,而私隐专员公署对于预设使用用户的个人资料来训练生成式人工智能模型的预设设定,是否正确反映用户的意愿,同样表示关注。因此,公署已去信领英了解有关情况。

个人资料私隐专员钟丽玲提醒领英用户应留意领英私隐政策的更新,了解相关政策内容,以决定是否同意领英使用他们的个人资料来训练人工智能模型。如果领英用户不愿意授权领英使用他们的个人资料进行生成式人工智能模型的训练,可以按照以下步骤(https://www.linkedin.com/mypreferences/d/categories/privacy)更改有关预设设定以撤销权限:

1. 前往帐户设定中的「资料隐私」部分,然后选择「用资料改进生成式AI」以找到相关选项。

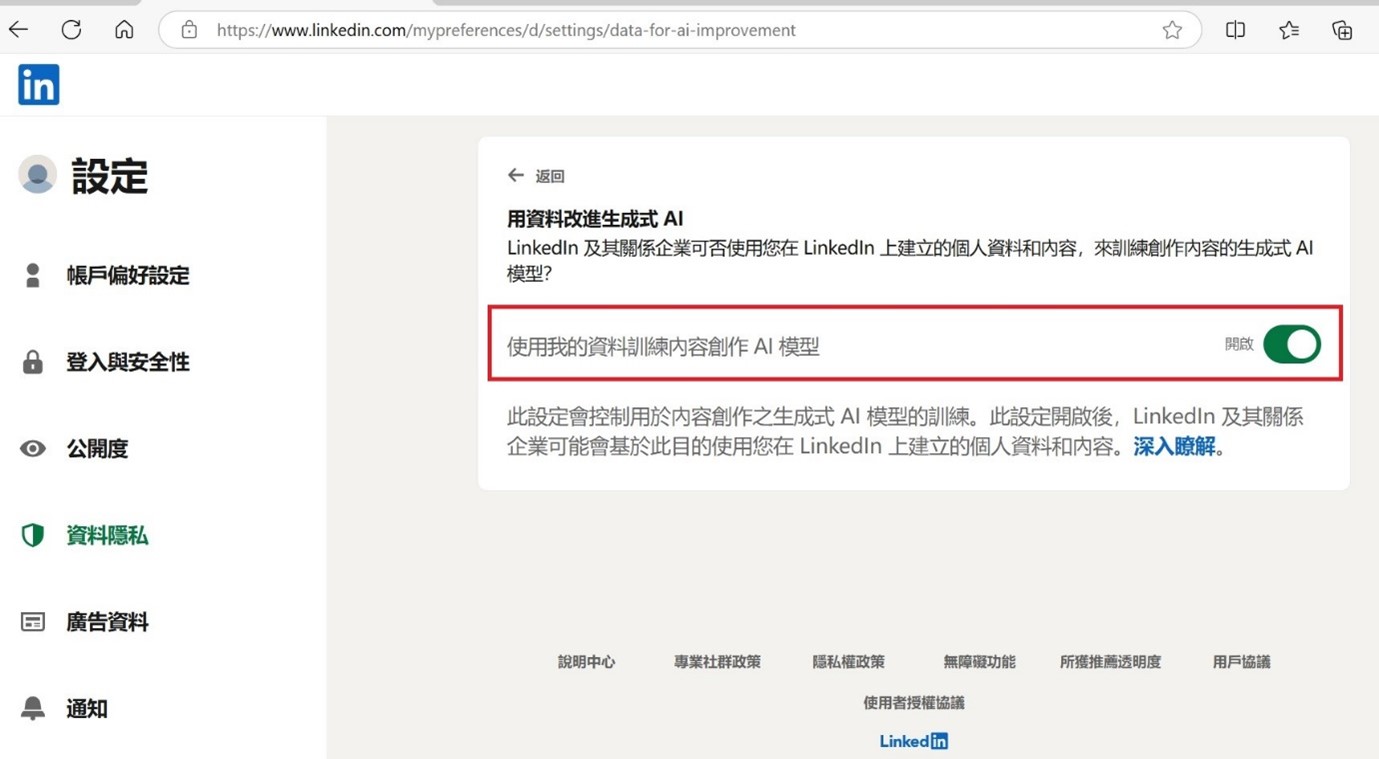

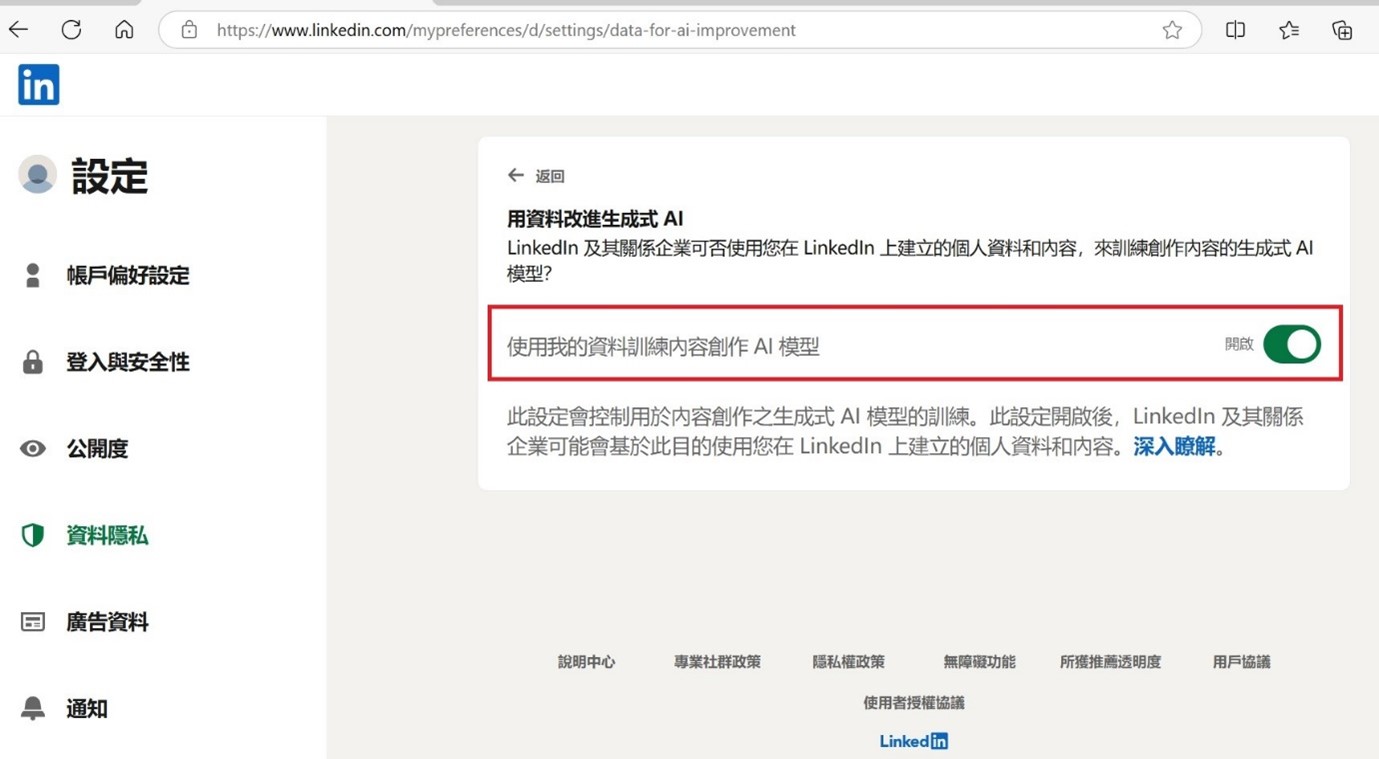

2. 关闭「使用我的资料训练内容创作AI模型」选项以撤销权限。

领英最近更新的私隐政策(撮要)

-完-